A Inteligência Artificial Generativa trouxe grandes avanços para a tecnologia e o cotidiano das pessoas e das empresas. Contudo, como toda tecnologia emergente, ela representa várias ameaças à segurança de dados.

Essas ameaças incluem riscos de vazamento de dados, violação de dados e não conformidade com as leis de privacidade de dados, como por exemplo a LGPD (Lei Geral de Proteção de Dados).

Os aplicativos de Inteligência Artificial Generativa (vamos nomeá-la agora simplesmente como IA Generativa), como o ChatGPT e Bard, são LLMs (Large Language Model - modelos de aprendizado de máquina) que aprendem com as informações que os usuários inserem.

Vamos pensar em alguns cenários práticos para identificarmos o risco.

Imagine uma empresa que está passando por um processo de aquisição ou fusão que ainda não foi tornada pública. Pesquisas subsequentes de outros usuários podem revelar essas informações.

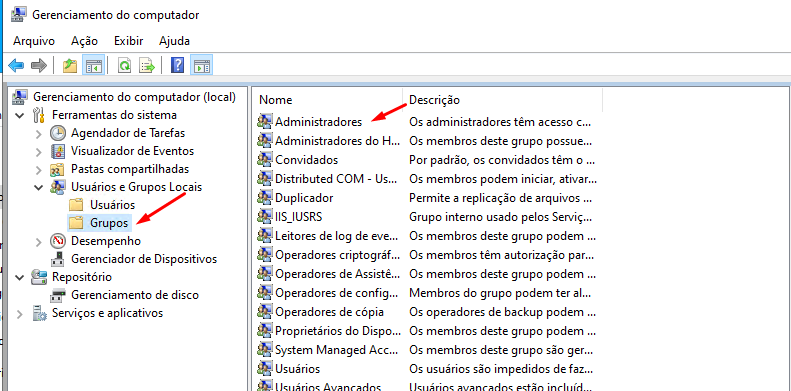

Ou imagine se um engenheiro de software usasse IA generativa para depurar código de software proprietário, essa propriedade intelectual estaria em risco de se tornar de domínio público — ou pior, acabar em posse de um concorrente.

Da mesma forma, se o engenheiro usasse a IA generativa para escrever código, ele talvez pudesse conter malware que forneceria a um invasor uma backdoor para o sistema de uma empresa.

Por fim, as leis de privacidade de dados (como a LGPD e GDPR), obrigam as organizações a proteger rigorosamente os dados pessoais. O uso de IA generativa para qualquer tipo de tratamento de dados pessoais poderia colocar a empresa em risco de não conformidade, pois essas informações poderiam vazar ou ser usadas incorretamente. Além disso, dados de propriedade intelectual, comercial e industrial podem ser vazados em uma simples consulta.

…

Leia Mais